Commençons par l’éléphant dans la pièce : si vous cherchez des informations sur Adobe Sensei en ce début 2026, vous allez tomber sur une surprise. Adobe a officiellement rebrandé Sensei en « Adobe AI » courant novembre 2025. La page officielle le dit noir sur blanc : « Adobe Sensei est désormais devenu Adobe AI. »

Est-ce que ça change quoi que ce soit concrètement dans vos logiciels ? Non. Les fonctionnalités sont les mêmes, le moteur tourne toujours pareil. C’est un repositionnement marketing pour englober trois couches d’IA — prédictive, générative et agentique — sous un même toit. Mais puisque tout le monde continue de chercher « Adobe Sensei » sur Google (et qu’Adobe eux-mêmes gardent le terme partout dans leur doc technique), on va garder ce nom dans cet article tout en parlant de ce que cette IA fait vraiment quand on la met à l’épreuve dans un pipeline de production.

Sensei, c’est quoi au juste ? Pas le pitch marketing, la vraie mécanique

Adobe Sensei, c’est le nom donné depuis 2016 au framework d’intelligence artificielle et de machine learning qui tourne en arrière-plan de quasiment tous les logiciels Adobe. Pas une application qu’on lance. Pas un bouton « IA » sur lequel on clique. C’est une couche invisible, un ensemble d’algorithmes qui analysent vos contenus, anticipent vos gestes et automatisent les corvées.

Techniquement, on parle de réseaux neuronaux convolutifs pour l’analyse d’images, toute l’architecture IA de Creative Cloud repose dessus, de modèles de traitement du langage naturel pour interpréter vos requêtes, et d’algorithmes prédictifs entraînés sur les milliards d’assets d’Adobe Stock et les données anonymisées d’utilisation de Creative Cloud. L’architecture est modulaire et cloud-native, ce qui permet à Adobe de déployer des mises à jour sans que vous ayez à télécharger quoi que ce soit.

La distinction fondamentale avec un outil comme Midjourney ou DALL·E : Sensei ne crée rien à partir de zéro. Il optimise ce que vous faites déjà. C’est de l’IA assistive, pas de l’IA générative. Pour la génération, Adobe a Adobe Firefly, son IA générative — on y reviendra.

Logiciel par logiciel : le test terrain

Photoshop : le terrain où Sensei est imbattable

C’est dans Photoshop que Sensei montre le mieux ce qu’il sait faire. Trois fonctionnalités sortent du lot après des mois d’utilisation intensive :

Sélection du sujet en un clic. On en parle depuis des années, mais en 2025-2026, la précision sur les cheveux, la fourrure et les bords semi-transparents a franchi un cap. Sur une photo studio bien éclairée, le détourage automatique est exploitable tel quel dans 8 cas sur 10. Sur des photos complexes (faible contraste sujet/fond, éclairage mixte), il faut encore passer du temps à affiner les masques manuellement. Mais le point de départ est tellement meilleur qu’il y a deux ans que le gain de temps est réel — facilement 5 à 10 minutes par image sur des retouches portrait.

Content-Aware Fill (remplissage d’après le contenu). C’est la fonctionnalité qu’Adobe met en avant depuis longtemps et elle reste impressionnante pour supprimer des éléments indésirables. La version actuelle gère mieux les textures répétitives (herbe, murs, ciel) que les zones à motifs complexes. Pour effacer un poteau d’une photo de paysage, c’est quasi magique. Pour retirer une personne devant une vitrine, comptez encore quelques retouches manuelles. Le guide officiel du Content-Aware Fill dans Photoshop détaille bien les cas d’usage.

Neural Filters. C’est là que l’IA se permet des choses plus audacieuses : modifier l’expression d’un visage, ajuster l’âge apparent, changer la direction du regard. Impressionnant en démo, plus nuancé en production. Les résultats sur des portraits en haute résolution tiennent la route. Sur des photos prises en basse lumière ou à faible résolution, des artefacts apparaissent assez vite. Utilisation recommandée : exploration créative et maquettes, pas forcément pour un livrable final sans retouche manuelle.

Ce qui manque encore : la Super Resolution (agrandissement sans perte) fonctionne, mais reste en dessous de ce que proposent des outils dédiés comme Topaz Gigapixel AI sur des agrandissements au-delà de 2x. Et les Neural Filters restent cantonnés au domaine du portrait — pas d’équivalent pour l’architecture, le produit ou le paysage.

Lightroom : l’organisateur silencieux

Lightroom, c’est le terrain de jeu de Sensei pour tout ce qui est classement et organisation. La reconnaissance faciale fonctionne correctement pour regrouper les séries portrait. La catégorisation automatique par sujet (paysage, portrait, architecture, nourriture) est fiable sur environ 85 % du catalogue après import.

L’ajustement automatique de la luminosité, du contraste et de la balance des blancs via « Auto » a beaucoup progressé. Sur des RAW bien exposés, le résultat auto est un point de départ tout à fait exploitable. Sur des fichiers sous-exposés ou à dominante colorée prononcée, la correction automatique se trompe encore régulièrement — elle a tendance à surexposer les ombres et à désaturer les tons chauds.

Verdict Lightroom : excellent pour le tri et l’organisation d’un gros volume. Correct mais pas suffisant pour la retouche créative en mode pilote automatique.

Illustrator : la vectorisation progresse, le reste attend

L’outil de vectorisation d’image propulsé par Sensei est une bonne surprise. Un croquis scanné proprement peut devenir une illustration vectorielle exploitable en quelques secondes. La fidélité des courbes a vraiment progressé par rapport aux versions précédentes, et la détection des traits fins s’est améliorée.

En revanche, les suggestions de palettes de couleurs et les aides à l’alignement restent assez basiques. On est loin d’un assistant de design intelligent — c’est plus du « snap-to-grid amélioré » qu’une véritable IA créative. Illustrator reste le logiciel Adobe où Sensei a le moins d’impact concret sur le workflow quotidien d’un graphiste expérimenté.

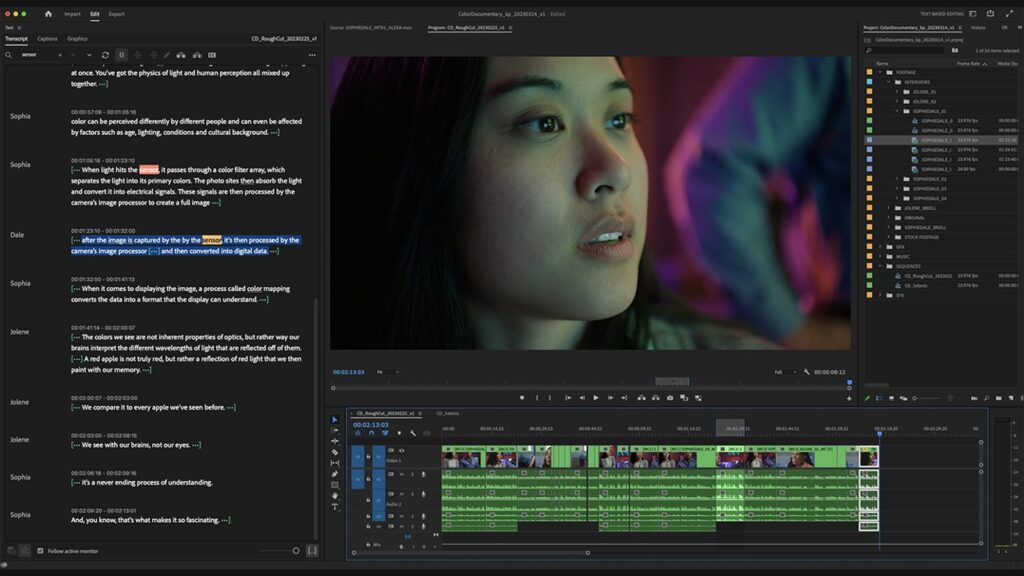

Premiere Pro : le monteur IA qui fait gagner des heures

C’est dans le montage vidéo que Sensei surprend le plus agréablement en 2025-2026. Plusieurs fonctionnalités changent véritablement le quotidien :

Auto Reframe. Vous avez une vidéo en 16:9 et vous devez la décliner en format vertical pour TikTok et en carré pour Instagram. Auto Reframe analyse le sujet principal et recadre automatiquement chaque plan. Sur des interviews face caméra, le résultat est quasi parfait. Sur des plans d’action avec plusieurs sujets en mouvement, il faut intervenir manuellement sur 20-30 % des coupes. Mais même avec ces ajustements, le gain de temps est considérable quand vous devez livrer 3 ou 4 formats pour chaque vidéo.

Sous-titrage automatique par reconnaissance vocale. La transcription speech-to-text intégrée est devenue très fiable en français. Le taux d’erreur a nettement baissé, même sur du vocabulaire technique. La ponctuation automatique est correcte dans la majorité des cas. Il reste des erreurs sur les noms propres et le jargon métier, mais la base de travail est solide.

Audio Remix. Un outil sous-estimé : il analyse la structure d’un morceau musical et le recale automatiquement sur la durée de votre timeline. Plus besoin de couper et fader manuellement la musique pour qu’elle colle au montage. Les tests des fonctionnalités IA de Premiere Pro 2025 confirment que c’est un énorme gain de temps, surtout sous deadline.

Ce qui reste perfectible : le Morph Cut (transition de saut entre deux prises d’interview) est toujours en bêta et produit des résultats visiblement artificiels dans la majorité des cas. La stabilisation vidéo est correcte mais en retrait par rapport à un DaVinci Resolve sur ce point précis. Et la correction colorimétrique automatique (Color Match) donne un point de départ acceptable, sans plus.

After Effects : l’animation gagne en accessibilité

Content-Aware Fill pour la vidéo (supprimer un objet d’une séquence entière) fonctionne, mais demande beaucoup de puissance de calcul et les résultats varient énormément selon la complexité de la scène. Sur un arrière-plan relativement statique, c’est bluffant. Sur une scène en mouvement avec des ombres dynamiques, attendez-vous à du travail de retouche frame par frame.

L’outil « Animer » qui génère des mouvements naturels à partir de positions clés est une bonne aide pour les motion designers qui débutent, mais les professionnels trouveront les courbes d’interpolation trop génériques pour un travail exigeant.

InDesign : l’IA en mode discret

InDesign est probablement le logiciel où Sensei reste le plus en retrait. Le redimensionnement adaptatif (Liquid Layout) aide à adapter une mise en page d’un format à un autre, mais les résultats sur des documents complexes (magazine, brochure multi-colonnes) nécessitent presque systématiquement des ajustements manuels importants. Les suggestions de polices similaires fonctionnent bien. Le reste de l’IA dans InDesign, pour être honnête, reste anecdotique en production.

Adobe Sensei vs Adobe Firefly vs IA agentique : la carte d’identité de chaque couche

Avec le rebranding en « Adobe AI », Adobe structure désormais son intelligence artificielle en trois couches distinctes. Comprendre la différence est essentiel pour utiliser chaque outil à bon escient.

Adobe Sensei (IA prédictive et assistive) — C’est le moteur de machine learning classique. Il analyse, prédit, optimise. C’est lui qui fait le détourage dans Photoshop, l’Auto Reframe dans Premiere Pro, le classement dans Lightroom. Il ne génère rien de nouveau : il améliore ce qui existe.

Adobe Firefly (IA générative) — Lancé en 2023, Firefly est le moteur text-to-image, text-to-video, text-to-audio d’Adobe. C’est lui qui propulse le Generative Fill dans Photoshop, la génération de vecteurs dans Illustrator, et depuis Adobe MAX 2025, la génération de pistes audio et de voix off. Firefly Image Model 5, annoncé en octobre 2025, pousse la résolution native à 4 MP. Firefly est entraîné sur Adobe Stock et du contenu sous licence — d’où la promesse « commercially safe » qui le distingue de Midjourney ou Stable Diffusion.

IA agentique (agents autonomes) — C’est la nouveauté 2025-2026. Adobe a dévoilé en avril 2025 ses premiers agents IA intégrés dans Photoshop, Premiere Pro, Express et Acrobat. Ces agents conversationnels comprennent le langage naturel et peuvent exécuter des séquences de tâches complexes. À Adobe MAX 2025, le projet « Moonlight » a été présenté comme un agent IA agentique créatif inter-applications qui collecte des insights depuis les réseaux sociaux créatifs et aide à passer de l’idée au contenu finalisé en quelques minutes.

| Caractéristique | Sensei (IA prédictive) | Firefly (IA générative) | Agents IA (IA agentique) |

|---|---|---|---|

| Fonction | Optimise l’existant | Crée du nouveau contenu | Automatise des workflows complets |

| Interaction | Invisible, en arrière-plan | Prompt textuel à la demande | Dialogue en langage naturel |

| Entraînement | Données propriétaires Adobe | Adobe Stock + domaine public | Modèles Firefly + données contextuelles |

| Disponibilité | Natif dans tous les logiciels | App dédiée + intégrations CC | En déploiement progressif (2025-2026) |

| Coût | Inclus dans l’abonnement CC | Crédits génératifs (limités/mois) | Inclus dans CC Pro |

Dans quels pipelines Sensei excelle vraiment ?

Après avoir passé du temps avec ces outils, voici les workflows où Sensei apporte un gain mesurable et concret :

Pipeline retouche portrait / e-commerce photo : détourage → retouche peau → correction couleur → export multi-format. Gain estimé : 30 à 50 % de temps sur les tâches techniques. C’est le pipeline roi de Sensei.

Pipeline montage vidéo social media : import → sous-titrage auto → Auto Reframe multi-format → Audio Remix → export. Sur une production régulière de contenus courts (Reels, TikTok, Shorts), le gain de temps est massif.

Pipeline organisation photographique : import RAW → classement auto → correction automatique de base → sélection rapide. Idéal pour les photographes événementiels qui gèrent des milliers de clichés par shooting.

Pipeline marketing / Experience Cloud : segmentation audience → personnalisation contenu → A/B testing automatisé → prédiction de performance. C’est le versant business de Sensei, moins visible pour les créatifs mais très puissant côté Adobe Sensei dans Experience Cloud via Adobe Target, Analytics et Journey Optimizer.

Là où Sensei ne suffit pas : tout workflow qui demande de la création pure (illustration, concept art, storyboard), de la retouche ultra-précise (beauté haut de gamme, compositing VFX), ou du montage narratif complexe. L’IA accélère les tâches mécaniques, mais le jugement artistique, la direction créative et la sensibilité esthétique restent à 100 % humains.

Ce qu’il faut améliorer : le point de vue terrain

Après avoir disséqué les capacités de Sensei logiciel par logiciel, voici les points faibles récurrents :

Cohérence inter-logiciels. Le niveau d’IA varie considérablement d’un logiciel à l’autre. Photoshop et Premiere Pro sont bien servis. InDesign et Illustrator restent en retrait. Audition a reçu quelques améliorations vocales mais rien de comparable.

Transparence sur ce qui est « Sensei » ou pas. Adobe affiche parfois un badge « Sensei » dans l’interface, parfois non. L’utilisateur ne sait pas toujours quand il bénéficie d’une assistance IA et quand il utilise un algorithme classique. Le rebranding en Adobe AI n’a pas clarifié la situation — il l’a même compliquée.

Dépendance au cloud. Certaines fonctionnalités Sensei fonctionnent en local, d’autres nécessitent une connexion internet pour accéder à la puissance de calcul d’Adobe. Le problème : Adobe ne communique pas clairement sur lesquelles marchent offline et lesquelles non. Pour un freelance qui travaille en déplacement ou sur un réseau instable, c’est un vrai irritant.

Absence d’API créative ouverte. Côté développeurs, les fonctionnalités API d’Adobe Sensei se limitent essentiellement à Experience Cloud (marketing, analytics). Il n’existe pas d’API publique pour intégrer la détection de sujet ou le Content-Aware Fill dans une application tierce. C’est un verrou important pour les studios qui voudraient automatiser leur pipeline de production au-delà de l’écosystème Adobe.

Neural Filters toujours en bêta perpétuelle. Certains filtres sont marqués « bêta » depuis leur lancement et ne semblent pas évoluer. L’impression, c’est qu’Adobe lance des démos technologiques impressionnantes mais ne les finit pas toujours.

Ce qui change avec l’IA agentique en 2026

Le développement le plus significatif, c’est l’arrivée des agents IA dans Creative Cloud. D’après les annonces d’Adobe MAX 2025, on va vers un modèle où l’utilisateur décrit ce qu’il veut en langage naturel — « prends les 5 meilleures photos de cette série, retouche-les pour un rendu lifestyle chaud, et exporte-les en 4 formats pour les réseaux sociaux » — et l’agent enchaîne les étapes automatiquement.

Plus de 75 % des utilisateurs Photoshop exploitent déjà les fonctionnalités propulsées par Firefly, selon Adobe. L’adoption de l’IA agentique devrait suivre le même schéma si les agents tiennent leurs promesses d’Adobe MAX.

Le Creative Cloud a aussi été restructuré en « Creative Cloud Pro » et « Creative Cloud Standard » courant 2025, avec des crédits génératifs Firefly limités par mois selon la formule choisie. Les fonctionnalités Sensei classiques (détourage, Auto Reframe, classement) restent incluses sans restriction dans tous les abonnements.

FAQ rapide

Sensei est-il inclus dans mon abonnement Creative Cloud ?

Oui, toutes les fonctionnalités Sensei classiques sont incluses sans surcoût. Les fonctionnalités Firefly (génération) utilisent des crédits mensuels dont le quota dépend de votre formule.

Quelle différence entre Sensei et Firefly ?

Sensei optimise l’existant (sélection, détourage, classement, recadrage). Firefly crée du nouveau contenu à partir de prompts textuels. Les deux sont complémentaires et cohabitent dans les mêmes logiciels.

Sensei fonctionne-t-il hors connexion ?

Partiellement. Les fonctions de base (sélection du sujet, Neural Filters embarqués) marchent en local. Les fonctions avancées (certaines analyses cloud, Super Resolution) nécessitent une connexion internet. Adobe ne documente pas clairement cette distinction.

Pourquoi Adobe a rebrandé Sensei en Adobe AI ?

Pour unifier sous une même marque les trois couches d’IA : prédictive (ex-Sensei), générative (Firefly) et agentique (les nouveaux agents). Dans la pratique, le nom « Sensei » reste omniprésent dans les interfaces et la documentation technique.

Est-ce que Sensei va remplacer les créatifs ?

Non. Après avoir testé l’outil en profondeur, la réalité est que Sensei excelle sur les tâches techniques et répétitives mais ne prend aucune décision artistique. Il accélère l’exécution, pas la vision. Un photographe qui ne sait pas composer une image ne sera pas sauvé par le détourage automatique. Un monteur qui n’a pas le sens du rythme ne produira pas un meilleur montage grâce à l’Auto Reframe.

Le mot de la fin

Adobe Sensei — ou Adobe AI, appelez-le comme vous voulez — n’est pas une révolution tape-à-l’œil. C’est un ensemble d’outils qui, pris individuellement, font chacun gagner quelques minutes. Mais additionnés sur un pipeline de production complet, ces minutes deviennent des heures. Et ces heures, un créatif freelance ou un studio les convertit en marge, en créativité retrouvée, ou simplement en soirées récupérées.

L’IA d’Adobe ne cherche pas à impressionner. Elle cherche à servir. Et quand on prend le temps de comprendre où elle excelle (Photoshop, Premiere Pro, Lightroom) et où elle reste en retrait (InDesign, After Effects sur les scènes complexes), on dispose d’un outil qui tient ses promesses — à condition de ne pas lui en demander plus qu’il ne peut donner.

Soyez le premier à commenter cet article !