L’intelligence artificielle n’est pas née avec ChatGPT. Cette idée, aussi séduisante soit-elle pour les observateurs pressés, occulte près d’un siècle de recherches, d’espoirs, de désillusions et de percées techniques. Quand des millions de personnes ont découvert les capacités conversationnelles des grands modèles de langage à partir de 2022, elles entraient en contact avec l’aboutissement — provisoire — d’une aventure scientifique qui remonte aux années 1940.

Comprendre cette histoire permet de mieux appréhender ce que l’IA peut réellement faire aujourd’hui, et surtout ce qu’elle ne peut pas faire. Car les promesses non tenues ont jalonné ce domaine autant que les succès retentissants.

Cet article retrace l’évolution de l’intelligence artificielle depuis ses origines jusqu’à janvier 2026, en intégrant les développements majeurs de la période 2020-2025 qui ont transformé notre rapport à ces technologies.

Les racines : quand les machines commencèrent à calculer

Enigma et la machine de Turing

L’histoire commence dans un contexte de guerre. Durant la Seconde Guerre mondiale, le mathématicien britannique Alan Turing travaille à Bletchley Park sur un problème crucial : décrypter les communications allemandes chiffrées par la machine Enigma.

Pour y parvenir, Turing et son équipe conçoivent la « Bombe », un dispositif électromécanique capable de tester des milliards de combinaisons possibles. Cette machine pouvait évaluer environ 159 milliards d’ajustements, un travail qui aurait occupé 10 000 cryptanalystes humains. Au-delà de son rôle militaire, la Bombe de Turing pose les fondations de ce qui deviendra l’intelligence artificielle : l’idée qu’une machine peut émuler certains processus cognitifs.

Test de Turing

Proposé en 1950, ce test suggère qu’une machine capable d’échanger avec un humain sans que celui-ci puisse déterminer qu’il s’agit d’une machine peut être considérée comme « intelligente ». Ce critère reste discuté, mais il a structuré des décennies de recherche.

Les années 1950 : poser les bases

En 1951, le Ferranti Mark 1 est installé à l’Université de Manchester. Présenté comme le premier ordinateur commercial au monde, il est accompagné d’un manuel rédigé par Turing lui-même. Malgré un démarrage prometteur, des restrictions budgétaires freinent son développement commercial.

Durant cette période, les chercheurs Allen Newell et Herbert Simon développent le General Problem Solver, un algorithme conçu pour résoudre des problèmes humains formulés sous forme de programmes. Bien que dépassé aujourd’hui, il influence encore les modèles de traitement symbolique de l’information à travers son successeur, l’architecture SOAR.

En 1958, John McCarthy, alors chercheur au MIT, crée le langage de programmation LISP. Ce langage restera pendant des décennies la référence pour le développement de systèmes d’intelligence artificielle.

1956 : naissance officielle de l’IA

La conférence de Dartmouth

L’été 1956 marque un tournant. Au Dartmouth College, dans le New Hampshire, une conférence réunit les figures majeures de ce qui va devenir un nouveau champ scientifique. John McCarthy, organisateur de l’événement, y propose le terme « intelligence artificielle » qui s’impose rapidement.

Herbert Simon et Allen Newell y présentent Logic Theorist, un programme capable de démontrer automatiquement des théorèmes mathématiques en reproduisant le plus fidèlement possible le raisonnement humain. Considéré aujourd’hui comme la première intelligence artificielle de l’histoire, le programme reçoit un accueil mitigé lors de la conférence — signe que les attentes étaient déjà très élevées.

Parmi les participants se trouvent également Marvin Minsky, futur fondateur du laboratoire d’IA du MIT, et Claude Shannon, père de la théorie de l’information. Ces pionniers partagent une ambition commune : créer des machines capables de rivaliser avec l’intelligence humaine, voire de la dépasser.

Les promesses formulées à Dartmouth étaient ambitieuses. Les participants estimaient qu’une machine véritablement intelligente pourrait être créée en quelques années. Cette sous-estimation de la difficulté du problème allait se répéter à plusieurs reprises dans l’histoire de l’IA.

1966 : le premier chatbot

ELIZA, l’ancêtre de ChatGPT

Joseph Weizenbaum, professeur au MIT, développe au milieu des années 1960 un programme qu’il baptise ELIZA. Sa particularité : il peut interagir avec des utilisateurs humains grâce à des scripts qui lui permettent de simuler différents interlocuteurs.

Conscient des limites de son programme, Weizenbaum cherche un contexte où des réponses mécaniques sembleraient naturelles. Il opte pour le rôle d’un psychothérapeute rogérien, dont la méthode consiste précisément à reformuler les propos du patient sous forme de questions.

Le résultat surprend son créateur : certains utilisateurs s’attachent à leur interlocutrice virtuelle et se confient à elle comme à une vraie thérapeute. Weizenbaum, troublé par cette réaction, deviendra par la suite un critique de l’intelligence artificielle.

ELIZA révèle une constante qui se vérifiera jusqu’à nos jours : les humains ont tendance à attribuer de l’intelligence et des émotions à des systèmes qui n’en possèdent pas, dès lors que ces systèmes produisent des réponses cohérentes dans un contexte approprié.

Les années 1970-1980 : le premier hiver de l’IA

Promesses non tenues et désillusions

Malgré l’enthousiasme initial et des financements conséquents, les résultats tardent à convaincre. La puissance de calcul disponible reste insuffisante pour les ambitions affichées. Les programmes d’IA des années 1960 fonctionnent dans des « micro-mondes » très contraints et échouent face à la complexité du monde réel.

Le rapport Lighthill, publié en 1973 au Royaume-Uni, dresse un constat sévère : les progrès sont bien en deçà des attentes. Les financements publics se tarissent, les laboratoires ferment, les chercheurs se reconvertissent. C’est le premier « hiver de l’IA ».

Raj Reddy et la reconnaissance vocale

Quelques avancées émergent néanmoins. Raj Reddy, professeur d’informatique à l’Université Carnegie Mellon, développe en 1973 HEARSAY, un système de reconnaissance vocale dont les techniques de programmation continuent d’influencer les programmes contemporains.

1972 : l’IA entre dans le monde médical

Système expert

Ensemble de logiciels utilisant une base de connaissances relative à un domaine spécifique pour formuler des recommandations ou résoudre des problèmes nécessitant normalement une expertise humaine. Un système expert comprend généralement une base de connaissances, un moteur d’inférence et une interface utilisateur.

MYCIN, développé par Edward Shortliffe à l’Université de Stanford, illustre cette approche. Programmé en LISP avec l’aide des professeurs de médecine de l’université, MYCIN peut diagnostiquer des infections bactériennes et proposer des traitements. L’utilisateur peut même lui demander d’expliquer son raisonnement — une fonctionnalité qui préfigure les préoccupations actuelles autour de l’explicabilité de l’IA.

MYCIN n’a jamais été déployé en pratique clinique, mais son architecture a influencé de nombreux systèmes experts ultérieurs dans des domaines variés : finance, industrie, conseil juridique.

Le Japon relance la course

À la fin des années 1970, le gouvernement japonais dévoile son projet d’ordinateur de cinquième génération, visant à développer des machines capables d’apprentissage automatique avancé. Cette annonce réveille l’intérêt américain et européen pour l’IA.

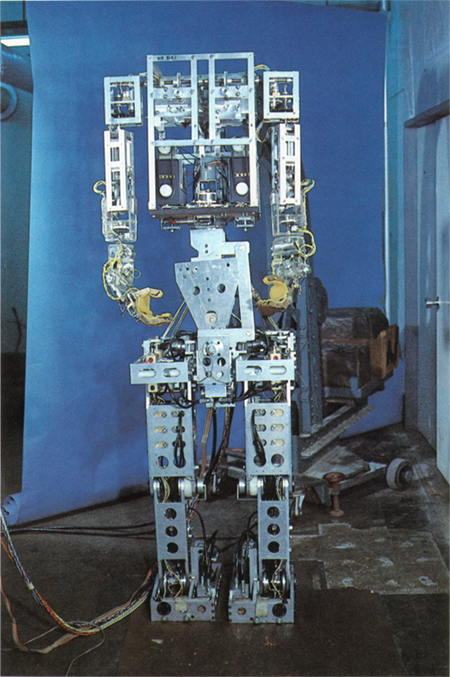

En 1973, l’Université de Waseda au Japon présente Wabot-1, le premier robot humanoïde intelligent et bipède. Il peut voir, marcher, saisir des objets et communiquer en japonais. Son apparence reste rudimentaire, mais il démontre la faisabilité d’une robotique intégrant plusieurs formes d’intelligence artificielle.

1986-1997 : le retour des connexionnistes

netTALK apprend à parler

En 1986, Charles Rosenberg et Terrence Sejnowski présentent netTALK, un programme capable de lire des mots et de les prononcer correctement. Plus remarquable encore : il peut enrichir sa base de données avec les mots qu’il ne connaît pas. netTALK fait partie des premiers réseaux de neurones artificiels à démontrer des capacités d’apprentissage convaincantes.

Cette approche connexionniste, longtemps éclipsée par les méthodes symboliques, commence à montrer son potentiel.

1997 : Deep Blue contre Kasparov

Le 11 mai 1997, le champion du monde d’échecs Garry Kasparov s’incline face à Deep Blue, le superordinateur d’IBM. La machine peut analyser 200 millions de positions par seconde, contre environ trois pour un joueur humain.

Cette victoire marque un tournant symbolique majeur. Pour la première fois, une machine bat le meilleur joueur humain dans un jeu considéré comme l’apanage de l’intelligence. Kasparov, qui avait gagné contre une version antérieure de Deep Blue l’année précédente, accusera IBM de tricherie — des allégations jamais prouvées.

Deep Blue ne « comprenait » pas les échecs au sens humain du terme. Il explorait un arbre de possibilités avec une puissance de calcul brute impossible à égaler pour un cerveau biologique. Ce type de victoire par la force computationnelle ouvrira la voie à d’autres approches.

Les années 2000-2010 : l’IA sort des laboratoires

2004-2005 : la course DARPA dans le désert

En mars 2004, la DARPA (agence de recherche du Département de la Défense américain) organise une course de véhicules autonomes dans le désert de Mojave. L’enjeu : parcourir 225 kilomètres sans intervention humaine. Un million de dollars attend l’équipe gagnante.

Aucun véhicule ne termine le parcours. Le meilleur d’entre eux ne parcourt que 11 kilomètres avant de s’immobiliser.

L’édition suivante, en octobre 2005, voit le robot Stanley remporter la course. Son équipe est dirigée par Sebastian Thrun, qui fondera par la suite le projet Google Car (devenu Waymo). Cette percée démontre que la conduite autonome est techniquement possible, même si sa généralisation prendra encore de nombreuses années.

2011 : Watson gagne Jeopardy!

En février 2011, le programme Watson d’IBM remporte le jeu télévisé Jeopardy! face à deux champions humains. Contrairement à Deep Blue qui excellait dans un domaine très structuré, Watson doit comprendre des questions formulées en langage naturel, souvent avec des jeux de mots ou des références culturelles.

Cette victoire illustre les progrès du traitement du langage naturel. IBM présentera Watson comme le début d’une nouvelle ère du « cognitive computing », promettant des applications révolutionnaires en médecine, finance et service client. Ces promesses se révéleront largement exagérées.

Les assistants vocaux arrivent

À partir de 2011, les assistants vocaux entrent dans le quotidien. Siri d’Apple est lancé cette année-là, suivi par Cortana de Microsoft en 2014 et Alexa d’Amazon en 2015. Ces systèmes combinent reconnaissance vocale, traitement du langage naturel et accès à des services en ligne.

Leurs capacités restent limitées — ils peinent avec les requêtes complexes ou les contextes ambigus — mais ils familiarisent le grand public avec l’idée d’interagir vocalement avec une machine.

2020-2025 : l’explosion des grands modèles

GPT-3 : le déclic

En juin 2020, OpenAI publie GPT-3, un modèle de langage comptant 175 milliards de paramètres. L’ampleur de ce chiffre impressionne, mais c’est surtout la qualité des textes générés qui stupéfie les observateurs.

GPT-3 peut rédiger des articles, écrire du code, répondre à des questions, traduire des langues — le tout à partir de simples instructions en langage naturel. Le modèle n’est pas parfait : il « hallucine » parfois des informations fausses, reproduit des biais présents dans ses données d’entraînement, et ne comprend pas véritablement ce qu’il écrit. Mais la fluidité de ses réponses change la perception de ce que l’IA peut accomplir.

Novembre 2022 : ChatGPT change la donne

Le 30 novembre 2022, OpenAI lance ChatGPT, une interface conversationnelle basée sur GPT-3.5. L’impact est immédiat : le service atteint 100 millions d’utilisateurs en deux mois, un record absolu pour une application grand public.

ChatGPT rend accessible au grand public ce qui restait jusque-là confiné aux développeurs et chercheurs. N’importe qui peut désormais dialoguer avec un système d’IA sophistiqué, lui poser des questions, lui demander de rédiger des textes ou d’expliquer des concepts complexes.

GPT-3 (juin 2020)

175 milliards de paramètres, accès par API uniquement. Démontre les capacités des grands modèles de langage.

ChatGPT (novembre 2022)

Interface conversationnelle grand public basée sur GPT-3.5. 100 millions d’utilisateurs en deux mois.

GPT-4 (mars 2023)

Capacités multimodales (texte et images), raisonnement amélioré, performances accrues sur les benchmarks académiques.

GPT-4o (mai 2024)

Modèle unifié traitant texte, images et audio. Temps de réponse réduit pour les interactions vocales.

GPT-5 (août 2025)

Intégration de la mémoire adaptative, meilleure cohérence sur les tâches longues, intégration poussée dans les workflows professionnels.

La réponse de Google : de Bard à Gemini

L’arrivée de ChatGPT provoque ce que les médias ont appelé un « code rouge » chez Google. L’entreprise avait développé LaMDA, un modèle conversationnel, mais hésitait à le déployer publiquement par prudence.

En février 2023, Google lance Bard, puis le rebaptise Gemini en février 2024 lors de l’intégration d’un nouveau modèle plus puissant. Gemini se décline en plusieurs versions : Nano pour les appareils mobiles, Pro pour un usage équilibré, et Ultra pour les tâches complexes.

Fin 2024, Google dévoile Gemini 2.0 avec des fenêtres de contexte étendues permettant de traiter des documents très longs. En novembre 2025, Gemini 3 est présenté comme le modèle le plus intelligent de Google à ce jour.

Anthropic et Claude : la sécurité d’abord

Anthropic, fondée en 2021 par d’anciens membres d’OpenAI dont Dario et Daniela Amodei, adopte une approche différente. L’entreprise développe Claude en mettant l’accent sur la sécurité et l’alignement avec les valeurs humaines.

Claude utilise une méthode appelée « IA constitutionnelle » : le modèle est entraîné à évaluer et réviser ses propres réponses selon un ensemble de principes éthiques. Cette approche vise à produire un assistant « utile, honnête et inoffensif ».

En mars 2024, Anthropic lance la famille Claude 3 avec trois variantes : Haiku (rapide), Sonnet (équilibré) et Opus (le plus capable). Claude 3.5 Sonnet, sorti en juin 2024, surpasse Claude 3 Opus sur de nombreux benchmarks tout en étant plus rapide. En mai 2025, Claude 4 est lancé avec Claude Opus 4 et Claude Sonnet 4, suivi par Claude Opus 4.5 en novembre 2025.

Meta et l’open source : Llama

Meta (anciennement Facebook) choisit une stratégie radicalement différente avec Llama. En février 2023, l’entreprise publie les poids de son modèle, permettant à quiconque de l’utiliser, le modifier et le déployer.

Llama 2 suit en juillet 2023 avec des modèles allant jusqu’à 70 milliards de paramètres. Llama 3, lancé en 2024, atteint 405 milliards de paramètres et introduit des capacités multimodales avec Llama 3.2. En avril 2025, Llama 4 adopte une architecture « mixture of experts » avec les modèles Scout et Maverick.

Cette approche open source a stimulé un écosystème d’innovation : des milliers de versions modifiées de Llama circulent, adaptées à des usages spécifiques allant de la médecine au droit en passant par la programmation.

L’explosion des IA génératives d’images

De DALL-E à Midjourney

Parallèlement aux modèles de langage, les systèmes de génération d’images connaissent une progression fulgurante. En janvier 2021, OpenAI présente DALL-E, capable de créer des images à partir de descriptions textuelles. DALL-E 2 suit en avril 2022 avec une qualité nettement améliorée.

Midjourney, lancé en février 2022 par le laboratoire indépendant de David Holz, se distingue par son esthétique picturale. Le système évolue rapidement : la version 6, sortie en décembre 2023, produit des images d’un réalisme saisissant avec une compréhension fine des instructions textuelles.

Stable Diffusion : l’open source s’impose

En août 2022, Stability AI publie Stable Diffusion en open source. Cette décision démocratise l’accès à la génération d’images par IA : n’importe qui disposant d’un ordinateur suffisamment puissant peut faire tourner le modèle localement.

La communauté s’empare de Stable Diffusion et produit des milliers de variantes spécialisées : styles artistiques particuliers, génération de personnages cohérents, contrôle fin de la composition. L’écosystème qui en résulte transforme les pratiques de nombreux créateurs visuels.

L’arrivée des IA génératives d’images a suscité d’intenses débats sur le droit d’auteur. Ces modèles sont entraînés sur des milliards d’images récupérées sur Internet, souvent sans consentement des créateurs originaux. Plusieurs procès sont en cours, et les questions juridiques restent largement non résolues.

La vidéo : Sora entre en scène

En février 2024, OpenAI dévoile Sora, un modèle capable de générer des vidéos à partir de descriptions textuelles. Les démonstrations impressionnent : personnages cohérents, mouvements fluides, compréhension apparente de la physique.

Sora est rendu public en décembre 2024 pour les abonnés ChatGPT Plus et Pro, d’abord aux États-Unis et au Canada. Les utilisateurs peuvent générer des vidéos jusqu’à 20 secondes en 1080p. En septembre 2025, Sora 2 représente un bond qualitatif majeur avec une meilleure simulation physique et la génération audio synchronisée.

Google répond avec Veo, tandis que d’autres acteurs comme Runway et Kling développent leurs propres solutions. La génération vidéo par IA reste cependant moins mature que la génération d’images ou de texte.

AlphaFold : l’IA au service de la science

Le problème du repliement des protéines

Depuis les années 1970, les biologistes butent sur un problème fondamental : prédire comment une protéine se replie dans l’espace à partir de sa séquence d’acides aminés. Cette structure tridimensionnelle détermine largement la fonction de la protéine — et donc son rôle dans la santé et la maladie.

Déterminer expérimentalement la structure d’une protéine peut prendre des mois ou des années. Avec plus de 200 millions de protéines connues, une approche computationnelle semblait indispensable.

La percée de DeepMind

En 2020, DeepMind, filiale de Google spécialisée dans l’IA, présente AlphaFold 2 lors de la compétition CASP (Critical Assessment of protein Structure Prediction). Le système atteint une précision de l’ordre de 90% pour les protéines de difficulté modérée — un niveau comparable aux méthodes expérimentales.

AlphaFold

Système d’intelligence artificielle développé par DeepMind pour prédire la structure tridimensionnelle des protéines à partir de leur séquence d’acides aminés. Utilise un réseau de neurones de type « transformer » entraîné sur les structures protéiques connues.

En 2021, DeepMind publie le code source d’AlphaFold 2 et lance une base de données contenant les structures prédites de plus de 200 millions de protéines — la quasi-totalité des protéines connues. Plus de 3 millions de chercheurs dans 190 pays ont depuis utilisé ces données.

Prix Nobel 2024

En octobre 2024, Demis Hassabis et John Jumper de DeepMind reçoivent le prix Nobel de chimie pour leurs travaux sur AlphaFold, partageant la récompense avec David Baker de l’Université de Washington pour ses recherches en conception computationnelle de protéines.

C’est la première fois qu’un prix Nobel récompense explicitement une avancée permise par l’intelligence artificielle. AlphaFold 3, annoncé en mai 2024, étend les capacités du système à la prédiction des interactions entre protéines, ADN, ARN et petites molécules — ouvrant la voie à des applications en découverte de médicaments.

L’état de l’IA en janvier 2026

Ce qui fonctionne

Les grands modèles de langage excellent dans certaines tâches : rédaction de textes, résumé de documents, traduction, assistance à la programmation, réponses à des questions factuelles (avec vérification). Les IA génératives d’images produisent des visuels de qualité professionnelle pour de nombreux usages. AlphaFold accélère réellement la recherche biologique.

Dans les entreprises, l’IA s’intègre progressivement aux processus existants : service client automatisé, analyse de documents, génération de rapports, aide à la décision. Les gains de productivité, quand ils sont mesurés rigoureusement, sont réels mais souvent plus modestes que les projections initiales.

Ce qui reste difficile

Les systèmes actuels ne « comprennent » pas le monde au sens humain. Ils ne raisonnent pas véritablement mais produisent des réponses statistiquement probables. Les hallucinations persistent : ces systèmes peuvent affirmer avec assurance des informations fausses. La fiabilité varie selon les domaines et les types de requêtes.

La conduite autonome totale (niveau 5) reste hors d’atteinte malgré des décennies de promesses. Les assistants vocaux peinent toujours avec les requêtes complexes. La traduction automatique, bien meilleure qu’il y a dix ans, n’égale pas un traducteur humain qualifié pour les textes exigeants.

Les questions ouvertes

Plusieurs débats structurent le domaine :

La concentration du pouvoir préoccupe : développer un modèle de pointe coûte des centaines de millions de dollars en calcul, réservant cette capacité à une poignée d’entreprises majoritairement américaines. L’approche open source de Meta avec Llama tente de contrebalancer cette tendance, mais les modèles les plus avancés restent propriétaires.

L’impact environnemental des centres de données nécessaires à l’entraînement et au fonctionnement des modèles soulève des questions légitimes. Les estimations varient considérablement, mais la consommation énergétique de l’IA croît rapidement.

Le marché de l’emploi se transforme, avec des effets difficiles à quantifier. Certains métiers voient leur productivité augmenter grâce à l’IA ; d’autres sont menacés d’automatisation partielle ou totale. Les prédictions apocalyptiques comme les promesses de création massive d’emplois semblent également exagérées.

La question de la régulation reste en suspens. L’Union européenne a adopté l’AI Act, première législation majeure encadrant l’IA. Les États-Unis privilégient une approche sectorielle moins contraignante. La Chine développe ses propres règles. Cette fragmentation réglementaire complique la donne pour les entreprises opérant à l’international.

L’intelligence artificielle de janvier 2026 n’est ni la révolution totale annoncée par ses promoteurs les plus enthousiastes, ni le danger existentiel décrit par ses critiques les plus alarmistes. C’est un ensemble d’outils puissants, avec des forces et des faiblesses spécifiques, qui transforment progressivement de nombreux domaines — à un rythme qui reste difficile à prédire.

Conclusion

De la machine Bombe de Turing aux modèles multimodaux de 2025, l’histoire de l’intelligence artificielle est celle d’une ambition récurrente confrontée aux limites de la technique. Chaque génération de chercheurs a cru tenir la clé de l’intelligence machine, avant de découvrir que le problème était plus complexe qu’anticipé.

Cette histoire enseigne la prudence face aux prédictions. Les hivers de l’IA ont succédé aux périodes d’euphorie ; il n’y a pas de raison de penser que ce schéma a définitivement cessé. Les capacités actuelles des systèmes d’IA sont remarquables, mais elles ne constituent pas une intelligence générale comparable à celle des humains.

Ce qui a changé depuis 2020, c’est l’accessibilité. Des millions de personnes interagissent quotidiennement avec des systèmes d’IA sophistiqués. Cette démocratisation accélère les usages, fait émerger des applications imprévues, et oblige la société à se confronter concrètement à des questions qui restaient théoriques.

L’histoire de l’IA continue de s’écrire. Elle sera façonnée autant par les percées techniques que par les choix politiques, économiques et éthiques que nous ferons collectivement. Comprendre d’où vient cette technologie aide à mieux appréhender où elle pourrait nous mener — sans céder ni à la fascination béate ni à la peur irrationnelle.

Soyez le premier à commenter cet article !