Définition

La réalité virtuelle (VR, pour Virtual Reality) est une technologie qui plonge l’utilisateur dans un environnement entièrement numérique et interactif, en simulant sa présence physique dans un monde artificiel. À l’aide d’un casque équipé d’écrans stéréoscopiques, de capteurs de mouvement et de contrôleurs, l’utilisateur peut regarder autour de lui, se déplacer et interagir avec les objets virtuels comme s’il y était réellement.

Contrairement à la réalité augmentée (AR) qui superpose des éléments numériques au monde réel, la VR remplace totalement l’environnement visuel de l’utilisateur. La réalité mixte (MR ou XR) se situe entre les deux : elle fusionne des objets virtuels avec l’environnement physique, permettant aux deux de coexister et d’interagir.

La réalité virtuelle est utilisée dans le jeu vidéo, la formation professionnelle (chirurgie, aviation, industrie), l’architecture et l’immobilier (visites virtuelles), le cinéma (expériences immersives), l’éducation, la thérapie médicale, le design industriel et la création de contenu 3D. C’est un débouché direct pour les compétences en modélisation 3D, en VFX et en motion design.

Comment fonctionne la réalité virtuelle

Le rendu stéréoscopique

Le casque VR affiche deux images légèrement décalées, une pour chaque œil, reproduisant la parallaxe binoculaire. Le même principe que la vision humaine, où chaque œil perçoit une image légèrement différente que le cerveau fusionne pour créer la sensation de profondeur. Le moteur de rendu (généralement Unreal Engine ou Unity) calcule la scène deux fois par frame, une pour chaque point de vue, ce qui double la charge de calcul par rapport à un rendu classique.

La résolution d’affichage des casques modernes atteint 2064 × 2208 pixels par œil sur le Meta Quest 3, et jusqu’à 3660 × 3200 pixels par œil (micro-OLED 4K) sur l’Apple Vision Pro. Ces résolutions élevées sont nécessaires parce que les lentilles du casque agrandissent l’image, une résolution insuffisante crée un effet de grille visible (screen door effect) qui brise l’immersion.

Le tracking 6DoF (six degrés de liberté)

Le tracking est le système qui détecte la position et l’orientation de la tête et des mains de l’utilisateur dans l’espace physique pour les traduire dans l’environnement virtuel. Le tracking 6DoF (six degrees of freedom) mesure six axes de mouvement : trois axes de translation (avant/arrière, gauche/droite, haut/bas) et trois axes de rotation (tangage, lacet, roulis). C’est ce qui permet de se pencher pour regarder sous une table virtuelle, ou de faire un pas de côté pour esquiver un objet.

Deux technologies de tracking coexistent. Le tracking inside-out utilise des caméras intégrées au casque qui analysent l’environnement pour calculer la position de l’utilisateur. C’est la méthode utilisée par le Meta Quest 3 et la majorité des casques autonomes. Aucune installation externe n’est nécessaire. Le tracking outside-in utilise des capteurs externes (stations de base) placés dans la pièce. C’est le système du Valve Index et du HTC Vive, qui offre une précision supérieure au prix d’une installation plus complexe.

Au-delà du tracking de la tête, les casques modernes intègrent le hand tracking (suivi des mains sans contrôleur, par analyse vidéo des caméras intégrées) et le eye tracking (suivi du regard par caméras infrarouges internes). L’Apple Vision Pro repose entièrement sur le eye tracking et le hand tracking pour son interface, pas de contrôleurs.

La latence : le seuil des 20 millisecondes

La latence motion-to-photon mesure le temps entre un mouvement de la tête de l’utilisateur et l’affichage de l’image mise à jour correspondante. Au-delà de 20 ms de latence, le décalage entre le mouvement réel et la réponse visuelle provoque des nausées (motion sickness) chez une large majorité des utilisateurs. C’est la contrainte technique la plus critique de la VR.

Pour maintenir cette latence sous le seuil, les casques ciblent un taux de rafraîchissement minimum de 90 Hz (90 images par seconde), avec les modèles récents atteignant 120 Hz voire 144 Hz. Combiné au rendu stéréoscopique (deux images par frame), cela signifie que le moteur de rendu doit produire 180 à 288 images par seconde, une charge de calcul considérable qui explique les exigences matérielles élevées de la VR.

Le champ de vision (FOV)

Le champ de vision (field of view) du casque détermine l’étendue de la zone visible. L’œil humain offre un FOV d’environ 200° en horizontal. Les casques VR actuels couvrent entre 90° et 130°, créant un effet de « vision tunnel » qui reste l’une des limitations de la technologie. L’Apple Vision Pro atteint environ 100° horizontalement, le Meta Quest 3 environ 110°, et le Valve Index environ 130°.

Les lentilles

Les lentilles du casque jouent un rôle fondamental dans le confort et la clarté de l’image. Les lentilles Fresnel (utilisées sur le Valve Index et le PSVR2) sont légères et peu coûteuses mais produisent des artefacts lumineux (god rays). Les lentilles pancake (utilisées sur le Meta Quest 3, l’Apple Vision Pro et le HTC Vive XR Elite) sont plus fines, offrent une meilleure clarté optique et permettent des casques plus compacts, mais coûtent plus cher à produire.

VR, AR, MR, XR : les distinctions

La réalité mixte (MR) est un terme souvent utilisé pour désigner les expériences qui mêlent VR et AR. Le passthrough des casques récents (Meta Quest 3, Apple Vision Pro) permet de voir l’environnement réel à travers les caméras du casque et d’y superposer des objets virtuels qui interagissent avec le monde physique (un personnage virtuel assis sur votre vrai canapé, par exemple).

Le terme XR (Extended Reality) englobe VR, AR et MR sous un même terme générique. C’est le terme privilégié par l’industrie et les standards techniques comme OpenXR.

Les casques VR en 2026

| Casque | Fabricant | Type | Résolution par œil | FOV | Tracking | Prix indicatif |

|---|---|---|---|---|---|---|

| Meta Quest 3 | Meta | Autonome + PC (Link) | 2064 × 2208 | ~110° | Inside-out 6DoF, hand tracking | ~550 € |

| Meta Quest 3S | Meta | Autonome | 1832 × 1920 | ~96° | Inside-out 6DoF, hand tracking | ~330 € |

| Apple Vision Pro | Apple | Autonome | 3660 × 3200 (micro-OLED) | ~100° | Inside-out, eye tracking, hand tracking | ~3 500 $ |

| PlayStation VR2 | Sony | Filaire (PS5) | 2000 × 2040 (OLED) | ~110° | Inside-out 6DoF, eye tracking | ~400 € |

| Valve Index | Valve | Filaire (PC) | 1440 × 1600 | ~130° | Outside-in (stations de base) | ~1 000 € |

| HTC Vive XR Elite | HTC | Autonome + PC | 1920 × 1920 | ~110° | Inside-out 6DoF | ~800 € |

| PICO 4 Ultra | ByteDance | Autonome + PC | 2160 × 2160 | ~105° | Inside-out 6DoF, eye tracking | ~600 € |

| Samsung Galaxy XR | Samsung/Google | Autonome (Android XR) | ~2K par œil | ~110° | Inside-out, eye tracking, hand tracking | ~TBA |

Le Meta Quest 3 domine le marché grand public grâce à son rapport qualité/prix et son écosystème d’applications. L’Apple Vision Pro se positionne sur le segment premium avec une qualité d’affichage inégalée et une interface entièrement contrôlée par le regard et les mains. Le PlayStation VR2 offre la meilleure expérience VR gaming sur console. Le Samsung Galaxy XR, premier casque sous Android XR (Google), marque l’entrée d’un nouvel écosystème dans la compétition.

Créer du contenu VR

Les moteurs de rendu temps réel

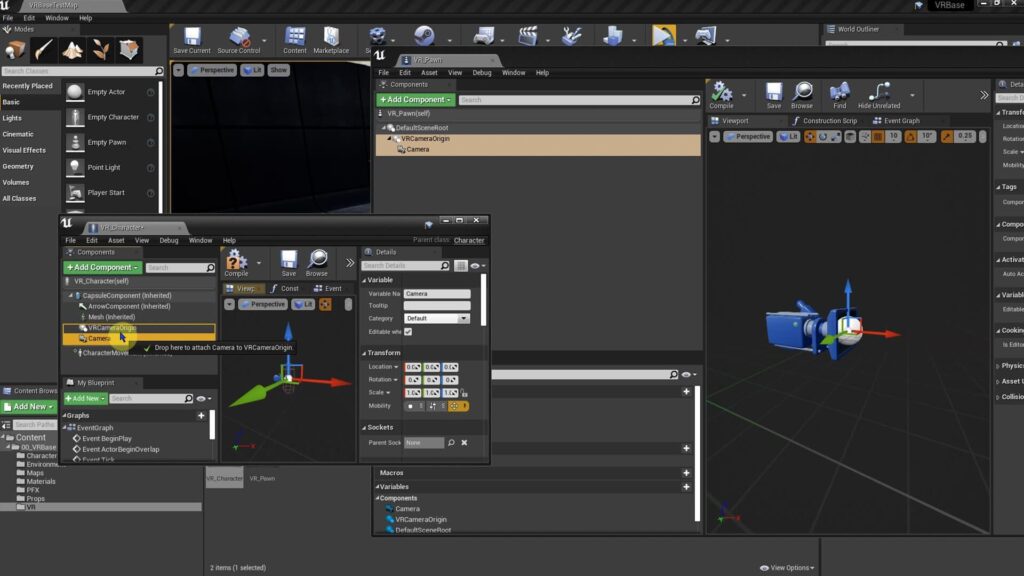

La création de contenu VR repose sur deux moteurs de jeu principaux qui gèrent le rendu stéréoscopique, le tracking et les interactions en temps réel.

Unity est le moteur le plus utilisé pour la VR, avec plus de 70% des applications du Meta Quest Store développées avec Unity. Son XR Interaction Toolkit simplifie le développement multiplateforme via le standard OpenXR. Unity 6 intègre l’IA Unity Muse pour accélérer la création de contenu, et son support natif du hand tracking en fait un outil complet pour la VR moderne.

Unreal Engine (Epic Games) est privilégié pour les expériences VR nécessitant un rendu visuel de haute qualité. Son moteur graphique plus puissant (Nanite, Lumen, MetaHuman) le rend idéal pour les expériences architecturales, les cinématiques VR et les jeux AAA, au prix d’une courbe d’apprentissage plus raide et d’exigences matérielles supérieures.

Les contraintes de la modélisation 3D pour la VR

Créer des assets 3D pour la VR implique des contraintes spécifiques au rendu temps réel. Le budget polygonal est limité : un casque autonome comme le Quest 3 gère environ 750 000 à 1,5 million de polygones par scène, contre des dizaines de millions pour un rendu hors-ligne dans Blender ou Maya. L’optimisation est donc fondamentale : LOD (Level of Detail) pour réduire la complexité des objets distants, texture atlasing pour minimiser les draw calls, baking d’éclairage pour pré-calculer les ombres plutôt que de les calculer en temps réel.

Les outils de modélisation 3D classiques (Blender, Maya, 3ds Max) restent utilisés pour la création des assets, qui sont ensuite exportés en FBX ou glTF et importés dans Unity ou Unreal Engine pour l’intégration VR.

Le spatial audio

Le son spatialisé (spatial audio ou audio 3D) est un composant essentiel de l’immersion VR. Contrairement au son stéréo classique, le spatial audio positionne chaque source sonore dans l’espace 3D autour de l’utilisateur. Quand vous tournez la tête, le son s’adapte en temps réel un oiseau à votre gauche reste à gauche dans l’espace virtuel, même si vous tournez la tête vers la droite. Les moteurs audio spatialisés comme Steam Audio, Oculus Audio SDK et Resonance Audio (Google) gèrent les réflexions, l’absorption et la propagation du son dans l’environnement virtuel.

WebXR : la VR dans le navigateur

WebXR est une API web standardisée par le W3C qui permet de créer des expériences VR et AR accessibles directement depuis un navigateur, sans installation d’application. Combiné à des bibliothèques comme Three.js ou A-Frame (Mozilla), WebXR permet de développer des expériences immersives en JavaScript, déployables sur n’importe quel casque compatible.

Le Meta Quest, le Samsung Galaxy XR et l’Apple Vision Pro (depuis visionOS 2, WebXR activé par défaut dans Safari) supportent tous WebXR, rendant la VR accessible sans passer par les stores propriétaires.

Les applications de la réalité virtuelle

Jeu vidéo

Le jeu vidéo reste le moteur principal de l’adoption grand public de la VR. Des titres comme Half-Life: Alyx (Valve, 2020), Beat Saber (Beat Games), Asgard’s Wrath 2 (Sanzaru Games/Meta) et Resident Evil 4 VR (Capcom/Armature) ont démontré que la VR peut offrir des expériences de jeu impossibles sur écran plat. Le catalogue du Meta Quest Store dépasse les 500 titres, et le PlayStation VR2 bénéficie du catalogue PlayStation.

Formation professionnelle et simulation

La VR transforme la formation dans les secteurs où l’erreur a un coût élevé ou un risque vital. La chirurgie (simulation d’opérations), l’aviation (simulateurs de vol), l’industrie (manipulation de machines dangereuses), les forces armées et les premiers secours utilisent la VR pour entraîner les professionnels dans des conditions réalistes mais sans risque. Des études montrent que la rétention d’information en formation VR atteint 80% après un an, contre 20% pour les méthodes traditionnelles.

Architecture et immobilier

La VR permet aux architectes et à leurs clients de visiter un bâtiment avant sa construction. Les maquettes BIM (modélisées dans Revit ou ArchiCAD) sont importées dans des moteurs temps réel pour des visites immersives à l’échelle 1:1. Dans l’immobilier, les visites virtuelles de biens existants (via Matterport ou des solutions sur mesure) permettent aux acheteurs de visiter un appartement à distance.

Santé et thérapie

La VR est utilisée en thérapie pour le traitement des phobies (exposition progressive en environnement contrôlé), la gestion de la douleur (distraction immersive pendant les soins), la rééducation motrice (exercices gamifiés) et le traitement du stress post-traumatique. Des plateformes comme AppliedVR ont obtenu des autorisations FDA pour des traitements de douleur chronique en VR.

Design industriel et prototypage

Les ingénieurs et designers utilisent la VR pour visualiser et manipuler des prototypes 3D à l’échelle réelle avant la fabrication. Un designer automobile peut s’asseoir dans un habitacle virtuel et évaluer l’ergonomie, les lignes de vue et les proportions sans construire de prototype physique. NVIDIA Omniverse et Gravity Sketch sont des outils de collaboration VR utilisés par les équipes de design industriel.

Éducation et culture

Les musées proposent des expériences VR pour reconstituer des sites historiques ou permettre l’exploration de lieux inaccessibles (fonds marins, surface de Mars, intérieur d’une cellule humaine). En éducation, la VR rend tangibles des concepts abstraits : explorer le système solaire en 3D, visiter une reconstitution de Rome antique, ou disséquer un cœur virtuel.

Histoire de la réalité virtuelle

1956 — Morton Heilig conçoit le Sensorama, une machine d’arcade qui stimule la vue, l’ouïe, le toucher et l’odorat pour créer une expérience immersive. C’est le premier prototype d’expérience de réalité virtuelle.

1968 — Ivan Sutherland et Bob Sproull créent « The Sword of Damocles », le premier visiocasque (head-mounted display) relié à un ordinateur. Le dispositif est si lourd qu’il doit être suspendu au plafond.

1989 — Jaron Lanier, fondateur de VPL Research, popularise le terme « réalité virtuelle » et commercialise les premiers gants et casques VR destinés au grand public.

1991 — Sega annonce le Sega VR pour sa console Mega Drive. Le projet est finalement abandonné, mais marque l’intérêt de l’industrie du jeu vidéo pour la VR.

1995 — Nintendo lance le Virtual Boy, un casque VR portable à écran monochrome rouge. C’est un échec commercial retentissant (770 000 unités vendues) qui refroidit l’industrie pour près de deux décennies.

2007 — Google lance Street View, une première forme de navigation virtuelle dans le monde réel via un écran classique.

2010 — Palmer Luckey, alors âgé de 17 ans, construit le premier prototype de l’Oculus Rift dans le garage de ses parents. La campagne Kickstarter en 2012 lève 2,4 millions de dollars.

2014 — Facebook (devenu Meta) rachète Oculus VR pour 2 milliards de dollars, signalant au monde que la VR est un marché stratégique. HTC et Valve annoncent le HTC Vive. Sony annonce le PlayStation VR.

2016 — L’Oculus Rift, le HTC Vive et le PlayStation VR sont commercialisés. C’est la « première vague » de la VR moderne, mais les prix élevés (600-800 $) et la nécessité d’un PC puissant limitent l’adoption.

2019 — Meta lance l’Oculus Quest, premier casque VR autonome de qualité à 399 $. Le tracking inside-out 6DoF sans capteurs externes démocratise la VR. C’est le tournant commercial.

2020 — Half-Life: Alyx (Valve) démontre qu’un jeu VR peut atteindre la qualité d’un titre AAA. Le Meta Quest 2 se vend à plus de 10 millions d’unités, porté par la pandémie et un prix agressif de 299 $.

2023 — Meta lance le Quest 3 avec passthrough couleur (réalité mixte). Apple dévoile le Vision Pro, positionnant la VR/MR comme « spatial computing ». Le terme XR (Extended Reality) s’impose dans l’industrie.

2025-2026 — Samsung et Google lancent le Galaxy XR sous Android XR. Valve annonce le Steam Frame avec eye tracking et foveated rendering intégrés. Le standard OpenXR se généralise. L’IA s’intègre dans les pipelines de création de contenu VR.

Tendances 2025-2026

Foveated rendering et eye tracking

Le foveated rendering est la tendance la plus impactante pour les performances VR. En combinant le eye tracking (suivi du regard) avec le moteur de rendu, le système concentre la puissance de calcul sur la zone où l’utilisateur regarde (fovéa) et réduit la résolution dans la vision périphérique. Le résultat est une amélioration perçue de la netteté de plus de 10 fois avec une charge GPU réduite de 30 à 50%. Le Valve Steam Frame, annoncé pour 2026, en fait sa fonctionnalité phare.

Passthrough et réalité mixte

La frontière entre VR et AR s’estompe. Les casques modernes (Quest 3, Vision Pro, Pico 4 Ultra) intègrent des caméras passthrough couleur haute résolution qui permettent de voir le monde réel tout en y superposant des objets virtuels. Cette convergence vers la réalité mixte ouvre des usages hybrides : travailler sur un bureau virtuel tout en voyant son clavier physique, jouer dans son salon avec des personnages virtuels qui interagissent avec les meubles réels.

IA dans la création de contenu VR

L’intelligence artificielle accélère la création de contenu VR. Unity Muse génère du code C# et des textures 3D à partir de prompts textuels. Les outils de deep learning permettent la génération procédurale d’environnements, l’animation automatique de PNJ, et l’upscaling en temps réel via le DLSS de NVIDIA. Les NeRF et le Gaussian Splatting (abordés dans l’article numérisation 3D) permettent de reconstruire des environnements réels navigables en VR à partir de simples photos.

Casques plus légers et autonomes

La tendance est aux casques autonomes (sans PC) avec des lentilles pancake qui réduisent l’épaisseur et le poids. Le Meta Quest 3 pèse 515 g, contre 900 g pour le HTC Vive original de 2016. Les puces mobiles dédiées à la XR (Qualcomm Snapdragon XR2+ Gen 2) offrent des performances graphiques suffisantes pour des expériences immersives sans connexion filaire.

OpenXR et interopérabilité

Le standard OpenXR (Khronos Group) unifie le développement VR/AR en proposant une API commune qui fonctionne sur tous les casques compatibles. Au lieu de développer une version pour Quest, une pour Vive et une pour Index, les développeurs écrivent une seule application OpenXR qui tourne partout. Unity 6 et Unreal Engine 5 utilisent OpenXR comme couche d’abstraction par défaut.