MetaHuman représente une révolution dans la création de personnages 3D. Cet écosystème d’Epic Games permet de générer des humains numériques photoréalistes, entièrement riggés et prêts à animer, en quelques minutes seulement. Gratuit pour les projets générant moins d’un million de dollars, MetaHuman démocratise l’accès à une qualité visuelle autrefois réservée aux studios AAA. Ce guide détaille chaque étape pour maîtriser cet outil et produire des personnages dignes des plus grandes productions.

Pourquoi MetaHuman redéfinit les standards

Avant MetaHuman, créer un personnage humain réaliste exigeait des mois de travail : modélisation, texturing, rigging facial avec des centaines de blendshapes, setup des yeux et des cheveux. Epic Games a condensé tout ce processus en un workflow accessible qui produit des résultats de qualité cinématographique.

Le système repose sur une base de données de scans humains réels. Chaque visage généré dans MetaHuman Creator résulte d’une interpolation intelligente entre ces références, garantissant des proportions anatomiquement correctes et des détails authentiques (pores, rides, variations de pigmentation). Cette approche élimine le risque de tomber dans l’uncanny valley qui piège tant de créations 3D.

Unreal Engine 5.7 + MetaHuman

Créez des humains numériques photoréalistes complets avec cheveux et vêtements en quelques minutes. Intégré à Unreal Engine 5.6+.

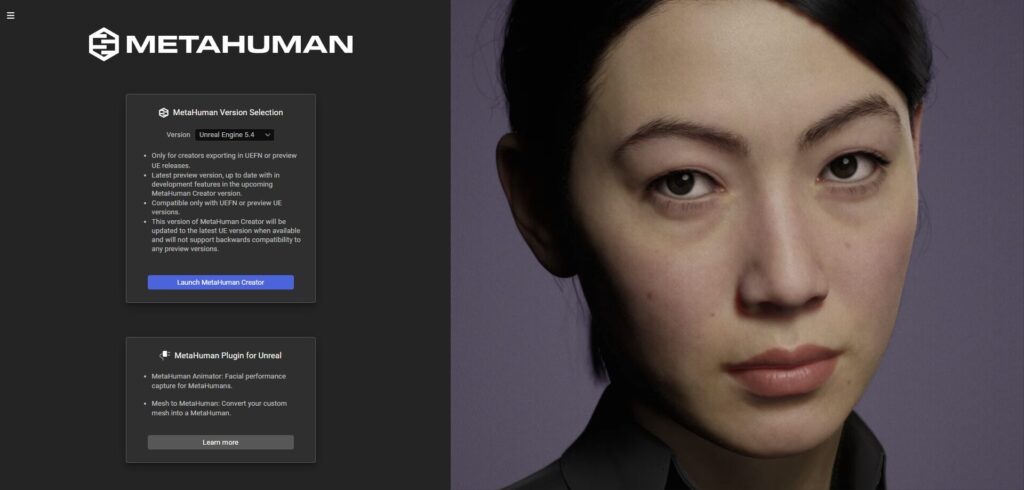

Depuis juin 2025, MetaHuman est sorti de l’Early Access avec des changements majeurs. Les outils sont désormais intégrés directement dans Unreal Engine 5.6+, la licence permet l’utilisation dans Unity, Godot ou tout autre moteur, et les personnages peuvent être vendus sur les marketplaces comme Fab. Cette ouverture transforme MetaHuman en solution véritablement universelle.

MetaHuman Creator : sculpter votre personnage

MetaHuman Creator constitue le point d’entrée principal. Désormais intégré à Unreal Engine (et non plus uniquement accessible via navigateur), l’outil propose trois modes de création complémentaires.

Le mode Blend permet de mélanger jusqu’à plusieurs presets pour créer une base unique. Sélectionnez des visages sources, ajustez les pourcentages de contribution de chacun, et observez en temps réel le résultat de l’interpolation. Cette approche produit rapidement des variations cohérentes tout en restant dans les limites du réalisme anatomique.

Le mode Move offre un contrôle plus direct. Des marqueurs sur le visage permettent de déplacer des zones entières (front, pommettes, mâchoire) pour modifier les proportions globales. C’est l’outil idéal pour ajuster la structure osseuse sans perdre les micro-détails de peau.

Le mode Sculpt apporte la précision finale. Chaque marqueur influence une zone spécifique du visage avec des chevauchements subtils. Par exemple, la région des yeux dispose de marqueurs séparés pour l’arcade sourcilière, les paupières supérieures et inférieures, et les coins internes/externes de l’œil. Le système trouve automatiquement la combinaison de caractéristiques faciales la plus proche dans la base de données de scans réels.

Désactivez temporairement les cheveux dans le viewport pour mieux voir et interagir avec les marqueurs de sculpture. Le mode Clay Material aide également à se concentrer sur la forme sans distraction.

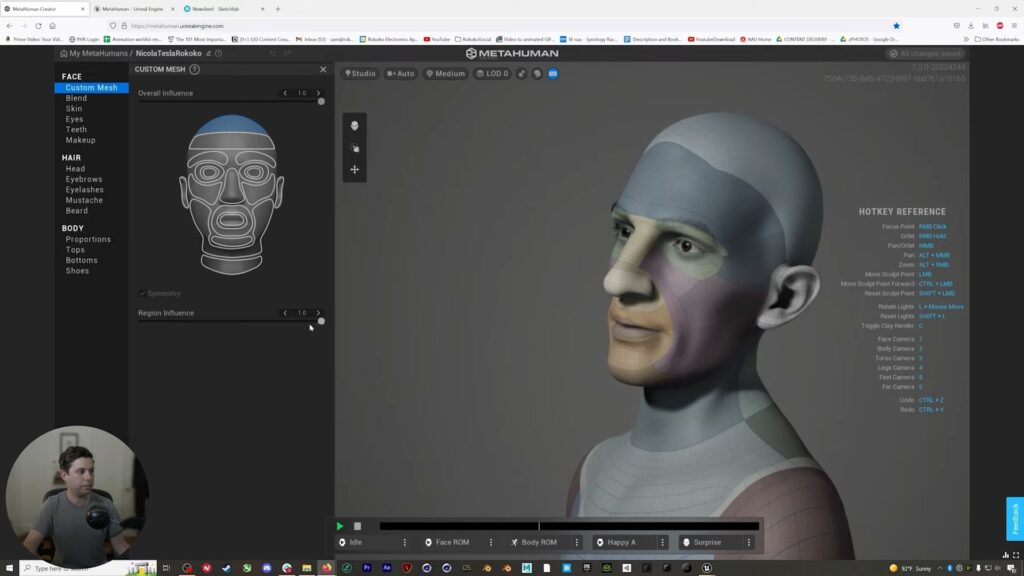

Mesh to MetaHuman : convertir vos propres créations

Pour les personnages nécessitant une ressemblance spécifique ou un style particulier, Mesh to MetaHuman permet d’importer votre propre mesh facial et de le convertir en MetaHuman complet.

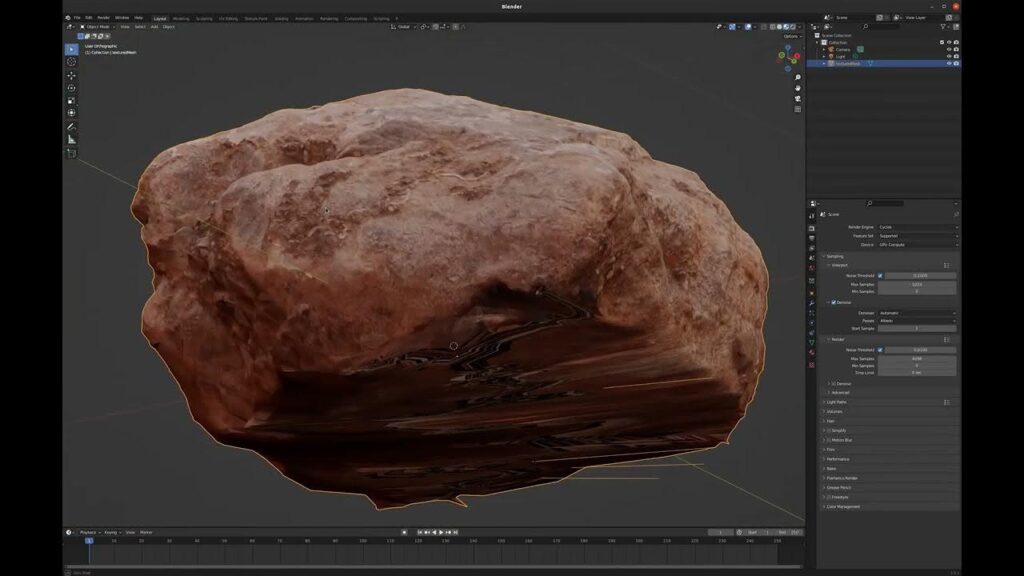

Le workflow accepte plusieurs sources : scans de photogrammétrie capturés avec RealityCapture ou Polycam, sculptures réalisées dans ZBrush ou Blender, ou modèles traditionnels. Les exigences techniques sont minimales : le mesh doit avoir un UV map (même auto-généré), afficher les yeux, le nez et la bouche clairement, et idéalement ne pas avoir de cheveux obstruant le visage.

RealityCapture

Logiciel de photogrammétrie pour créer des scans 3D haute fidélité à partir de photos. Idéal pour le workflow Mesh to MetaHuman.

Le processus dans Unreal Engine se déroule ainsi : créez un MetaHuman Identity Asset, importez votre mesh, et le système place automatiquement des landmarks sur les traits faciaux. Ces marqueurs guident le solver qui adapte la topologie MetaHuman standard à votre forme personnalisée. Le résultat est un personnage combinant votre design unique avec tout l’écosystème MetaHuman (rigging, animations, matériaux).

Pour les digital doubles d’acteurs réels, la photogrammétrie produit les meilleurs résultats. Capturez le visage en expression neutre, yeux ouverts, sous éclairage diffus et uniforme. Un setup avec 50-100 photos couvrant tous les angles suffit pour un scan de qualité. Nettoyez le mesh dans Blender ou ZBrush (suppression des artefacts, comblement des trous) avant l’import.

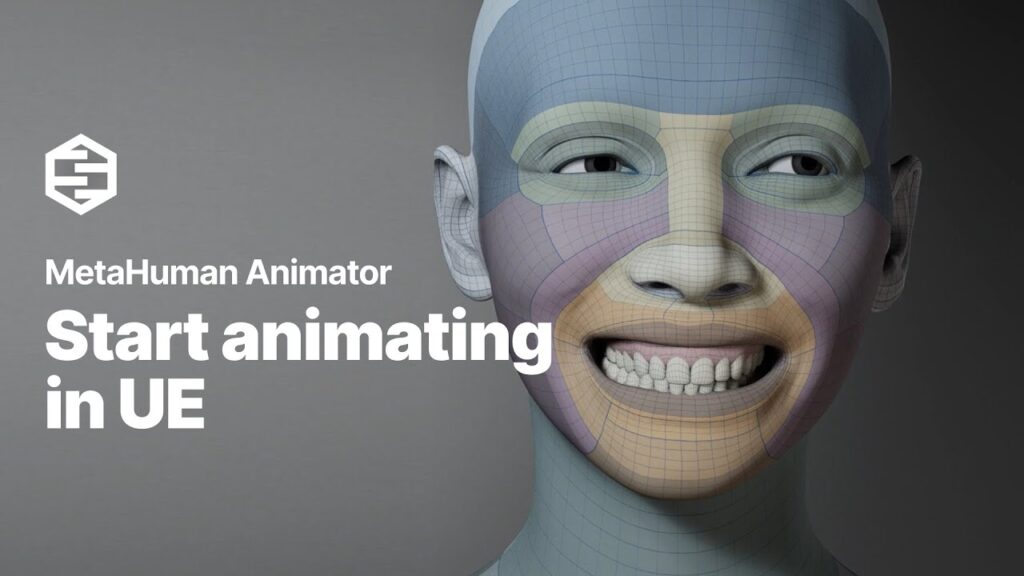

MetaHuman Animator : capturer des performances faciales

MetaHuman Animator révolutionne l’animation faciale en la rendant accessible sans équipement professionnel. L’outil génère des animations haute fidélité à partir de sources variées, du simple iPhone aux systèmes HMC (Head-Mounted Camera) professionnels.

Depuis la version 5.6, MetaHuman Animator supporte les caméras mono : webcams, téléphones Android, ou tout appareil compatible Live Link. La capture se fait en temps réel directement dans Unreal Engine, permettant de voir immédiatement le résultat sur votre personnage. Pour les productions exigeant une fidélité maximale, les iPhone 12+ avec capteur TrueDepth ou les systèmes HMC stéréo de Technoprops offrent une précision supérieure.

Live Link Face App

Application gratuite iOS pour capturer des performances faciales et les streamer vers Unreal Engine en temps réel.

La nouveauté la plus significative : l’animation depuis l’audio uniquement. MetaHuman Animator analyse le signal vocal en temps réel pour générer non seulement le lip-sync mais aussi les mouvements de tête et les expressions émotionnelles appropriées. Vous pouvez même ajuster manuellement le ton émotionnel pour correspondre à l’intention de votre scène.

Le workflow de capture avec iPhone typique : installez Live Link Face sur votre appareil, connectez-le à Unreal via WiFi, activez le plugin MetaHuman Live Link, et commencez à enregistrer avec Take Recorder. Les performances capturées s’appliquent à n’importe quel MetaHuman grâce au rig standardisé.

Personnaliser la peau avec les matériaux avancés

Les shaders de peau MetaHuman atteignent un niveau de réalisme remarquable grâce au Subsurface Scattering (SSS) qui simule la pénétration et diffusion de la lumière dans l’épiderme. Plusieurs paramètres permettent d’affiner l’apparence selon vos besoins.

Le Subsurface Profile contrôle le comportement SSS global. Le scatter radius définit la distance de diffusion de la lumière sous la peau, les peaux claires nécessitant généralement des valeurs plus élevées avec des teintes rougeâtres, les peaux foncées des valeurs plus basses avec des teintes orangées-brunes. Ajustez ces paramètres sous différents éclairages pour éviter un aspect cireux.

Les textures sont disponibles en résolutions 2K, 4K et 8K. Pour les gros plans cinématiques, les textures 8K révèlent chaque pore et ridule. Les productions temps réel peuvent réduire à 4K ou 2K avec un impact visuel minimal à distance moyenne. Le système de LOD (Level of Detail) gère automatiquement ces transitions.

Texturing XYZ

Bibliothèque de scans de peau haute résolution. Partenaire officiel pour les textures MetaHuman et Character Creator.

La section Skin de MetaHuman Creator permet de filtrer les textures par densité de rides, pilosité faciale, taches de rousseur et grains de beauté. Des onglets dédiés contrôlent les rougeurs par zone (joues, nez, oreilles) et les détails comme les taches de vieillesse ou l’acné. Pour des personnalisations avancées, exportez les textures, modifiez-les dans Substance Painter ou Photoshop, et réimportez-les via les Material Instances.

Créer des coiffures personnalisées avec les Groom Tools

Les cheveux MetaHuman utilisent le système Groom d’Unreal Engine : des cheveux strand-based (brin par brin) simulés physiquement. Le résultat dépasse largement les traditionnelles hair cards en termes de réalisme, particulièrement en mouvement.

MetaHuman Creator propose des coiffures préconçues, mais les workflows de personnalisation permettent d’aller bien plus loin. Les Groom Tools officiels pour Houdini fournissent des HDAs (Houdini Digital Assets) pour créer des coiffures complexes : tresses, chignons, cornrows, queues de cheval. Le workflow guide-driven utilise des données pré-autorisées pour itérer rapidement.

MetaHuman for Houdini

Plugin gratuit avec HDAs pour créer des grooms compatibles MetaHuman dans Houdini. Export Alembic vers Unreal.

Pour les artistes Maya, le MetaHuman Groom Starter Kit offre un workflow structuré utilisant XGen. Créez vos guides, stylisez les cheveux, et exportez en format Alembic compatible. Le plugin MetaHuman for Maya facilite également l’export des grooms avec les attributs corrects (Root UV, Group ID, hair width).

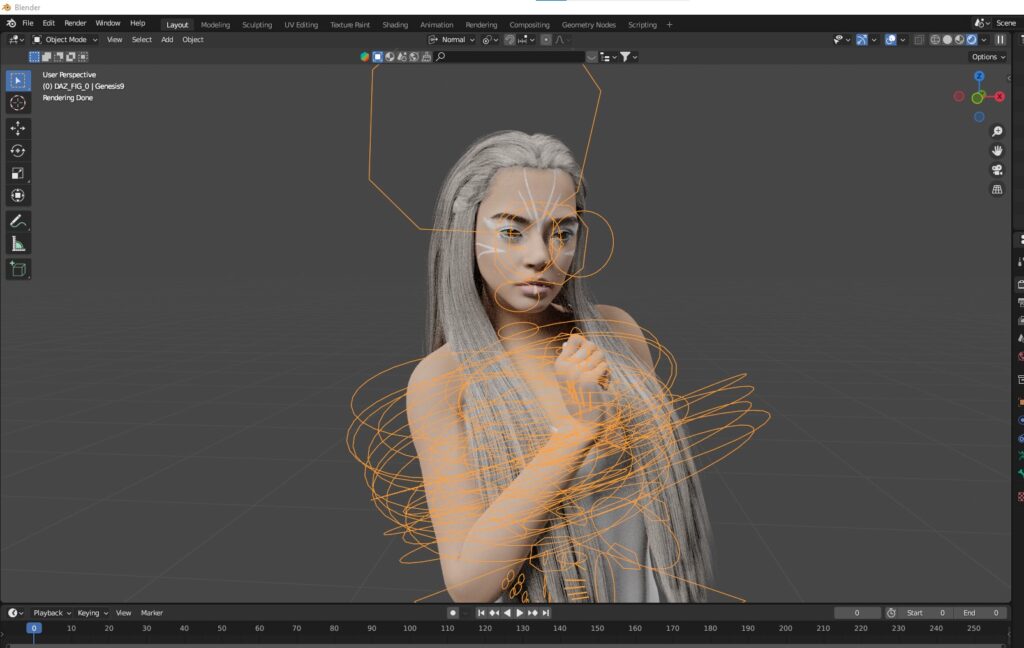

Blender dispose désormais d’un écosystème communautaire solide. Le Groom Exporter Plugin (gratuit) permet d’exporter les systèmes de particules Blender en Alembic compatible MetaHuman. Le MetaHuman Groom Starter Kit pour Blender sur Fab fournit des fichiers de référence utilisant les Geometry Nodes.

Workflow avec Maya et DCC externes

Le plugin MetaHuman for Maya (gratuit, compatible Maya 2022-2026) ouvre des possibilités avancées. Vous pouvez manipuler directement le mesh MetaHuman avec les outils de sculpture et d’édition Maya, appliquer des corrections techniques, art-diriger les expressions, et créer des personnages stylisés ou non-humains.

Le workflow d’édition typique : exportez votre MetaHuman depuis Unreal via le pipeline DCC Export, importez-le dans Maya où il s’assemble automatiquement avec rig et textures, effectuez vos modifications (sculpture, ajout d’accessoires, ajustement des poids de skinning), puis réexportez vers Unreal. Le round-trip préserve la compatibilité avec l’animation et les autres fonctionnalités MetaHuman.

Pour les créatures ou personnages stylisés, commencez par un MetaHuman de base avec des proportions proches de votre cible. Sculptez les modifications dans ZBrush ou Maya (museau, oreilles pointues, écailles), puis utilisez Mesh to MetaHuman pour générer un nouveau rig adapté à votre forme. Les blendshapes faciales sont recalculées pour fonctionner avec la nouvelle géométrie.

Pour les personnages très modifiés, testez systématiquement les animations faciales. Des déformations trop extrêmes peuvent casser le rig ou produire des résultats inattendus lors des expressions intenses.

Optimisation pour le temps réel

Les MetaHumans sont optimisés pour le temps réel mais restent exigeants en ressources. Le système de LOD intégré propose jusqu’à 8 niveaux de détail, réduisant automatiquement la complexité selon la distance à la caméra.

Pour les projets jeu vidéo, plusieurs optimisations s’imposent. Réduisez les textures à 4K ou 2K pour les personnages secondaires. Utilisez des grooms moins denses (moins de brins) ou convertissez-les en hair cards pour les performances les plus contraintes. Le shader de peau « Medium » offre un bon compromis qualité/performance pour les personnages d’arrière-plan.

Les hair cards constituent une alternative aux grooms strand-based quand les performances l’exigent. Générez-les depuis vos grooms haute fidélité pour conserver l’apparence visuelle avec un coût GPU réduit. Les projets UEFN (Fortnite) utilisent cette approche : les MetaHumans passent de ~1 Go à 60 Mo grâce à ces optimisations.

Pour le ragdoll et la physique, les MetaHumans intègrent Chaos (le moteur physique d’UE5) avec des paramètres pré-configurés. Les personnages tentent même de protéger leur tête lors des chutes, un détail qui renforce le réalisme.

Vêtements et accessoires

Le système Outfit Asset unifie vêtements et accessoires en un seul fichier qui s’adapte automatiquement aux différentes morphologies corporelles. Depuis la version 5.6, vous pouvez créer des vêtements personnalisés plutôt que sélectionner uniquement parmi les presets.

L’intégration avec Marvelous Designer permet de concevoir des vêtements dynamiques dans CLO/Marvelous Designer, de prévisualiser leur apparence sur votre MetaHuman, puis d’exporter vers Unreal via USD. Les simulations de tissu se transfèrent avec le personnage pour un comportement réaliste.

Marvelous Designer

Logiciel de création de vêtements 3D avec simulation de tissu. Intégration officielle avec MetaHuman.

Pour les vêtements importés d’autres sources, skinnez-les sur le squelette MetaHuman dans votre DCC, en respectant les 18 presets corporels standards. Importez en FBX, attachez au bone root dans le Blueprint, et configurez la physique de tissu si nécessaire. Les LODs doivent correspondre à ceux du corps pour éviter des artefacts lors des transitions.

Le marketplace Fab (anciennement Quixel Bridge + UE Marketplace fusionnés) propose désormais des vêtements, coiffures et accessoires MetaHuman-ready. Vous pouvez également vendre vos propres créations avec une part créateur de 88%.

Licensing et utilisation commerciale

La nouvelle licence (depuis UE 5.6) simplifie considérablement les conditions d’utilisation. MetaHuman est couvert par la licence standard Unreal Engine :

Gratuit jusqu’à 1 million de dollars de revenus annuels. Aucune redevance, aucune restriction sur le type de projet (jeux, films, publicités, applications).

Au-delà de 1 million de dollars, les conditions standard Unreal Engine s’appliquent : 5% de royalties pour les jeux uniquement, pas de royalties pour le contenu linéaire (films, séries), l’architecture, l’automobile, etc.

Export vers d’autres moteurs : les MetaHumans peuvent désormais être utilisés dans Unity, Godot ou tout autre moteur/logiciel 3D. Les personnages comptent comme « non-engine products » et échappent donc aux royalties quand exportés.

Vente de contenus : vous pouvez vendre vos personnages MetaHuman, vêtements et accessoires sur Fab ou d’autres marketplaces. Les animations créées avec MetaHuman Animator sont également commercialisables.

Restrictions : l’utilisation pour l’entraînement d’IA ou la reconnaissance faciale reste interdite. Le contenu doit respecter les guidelines Epic (pas de contenu « socialement inacceptable »).

Comparaison avec les alternatives

Comment MetaHuman se positionne face à Character Creator 5 et Daz Studio ?

vs Character Creator 5 : CC5 offre plus de liberté créative (ActorMIXER, personnages stylisés, créatures) et fonctionne en local sans dépendance cloud. MetaHuman surpasse CC5 en réalisme photoréaliste brut et intégration Unreal native. CC5 coûte $299+ tandis que MetaHuman est gratuit.

vs Daz Studio : Daz excelle pour les images statiques avec Iray et propose une bibliothèque communautaire massive. MetaHuman domine pour l’animation temps réel et les pipelines de production. Les deux peuvent se compléter : utilisez Daz Face Transfer pour créer des visages personnalisés, puis convertissez-les en MetaHuman.

vs création manuelle : modéliser, texturer et rigger un personnage réaliste from scratch prend des semaines/mois. MetaHuman produit un résultat comparable en minutes. Pour les personnages héros nécessitant un contrôle total, combinez les deux approches : base MetaHuman + customisation DCC.

La force unique de MetaHuman réside dans son écosystème intégré : création, animation faciale, rendu temps réel, tout fonctionne ensemble sans friction. Pour les équipes travaillant dans Unreal Engine, c’est le choix évident.

Ressources et apprentissage

L’écosystème d’apprentissage MetaHuman est particulièrement riche :

La documentation officielle sur dev.epicgames.com couvre chaque aspect en détail : guides de démarrage, références techniques, troubleshooting. Les tutoriels vidéo Epic expliquent les workflows complexes comme Mesh to MetaHuman ou le grooming Houdini.

Les forums Epic Developer Community regroupent une communauté active partageant solutions et workflows. Les fils sur l’optimisation, les créatures non-humaines et l’intégration avec d’autres outils sont particulièrement utiles.

Epic Developer Community

Forums officiels, tutoriels communautaires et documentation pour MetaHuman et Unreal Engine.

Les tutoriels communautaires sur YouTube (JSFilmz, Pixel Profi) détaillent des workflows pratiques avec des exemples concrets. Les articles 80.lv et fxguide analysent les productions professionnelles utilisant MetaHuman.

Pour la photogrammétrie, les ressources de Capturing Reality et 3D.sk guident le processus de scan vers MetaHuman. Les artistes de Texturing XYZ partagent des breakdowns détaillés de leurs créations de personnages photoréalistes.

Soyez le premier à commenter cet article !